之前写过一篇文章 【AI+本地知识库】个人整理的几种常见本地知识库技术方案 , 由于当时主要是针对AI本地知识库, 所以没列fastGPT。 最近经常刷到fastGPT,这里单独水一篇。

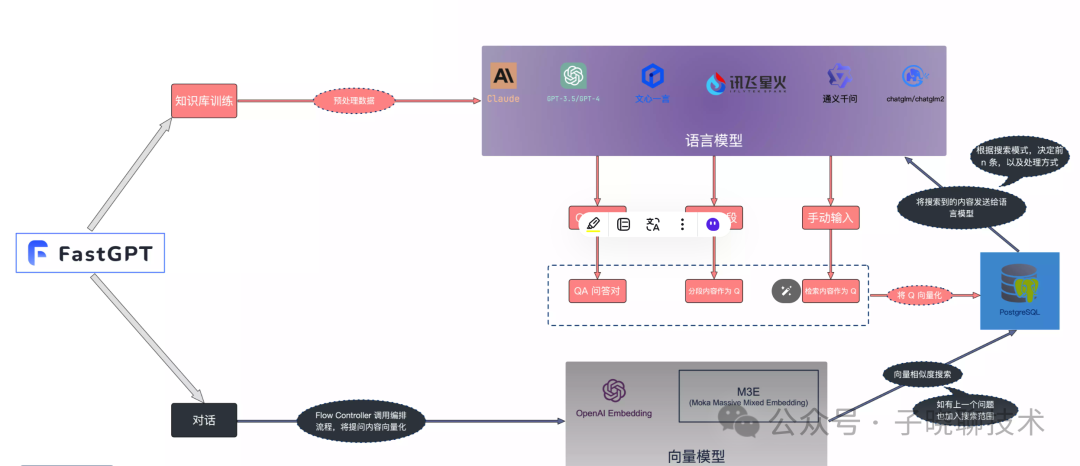

FastGPT 是一个基于 LLM 大语言模型的知识库问答系统,提供开箱即用的数据处理、模型调用等能力。同时可以通过 Flow 可视化进行工作流编排,从而实现复杂的问答场景!看下图

如何快速上手

开始前,请准备一份测试电子文档,WORD,PDF,TXT,excel,markdown 都可以,比如公司休假制度,不涉密的销售说辞,产品知识等等。

这里使用 FastGPT 中文 README 文件为例。

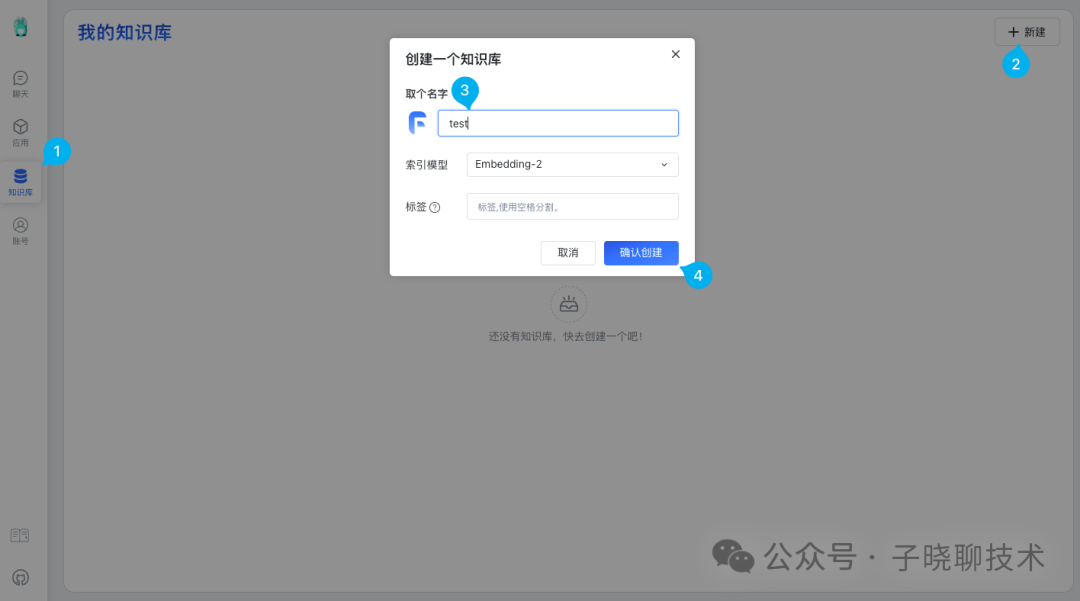

首先我们需要创建一个知识库。

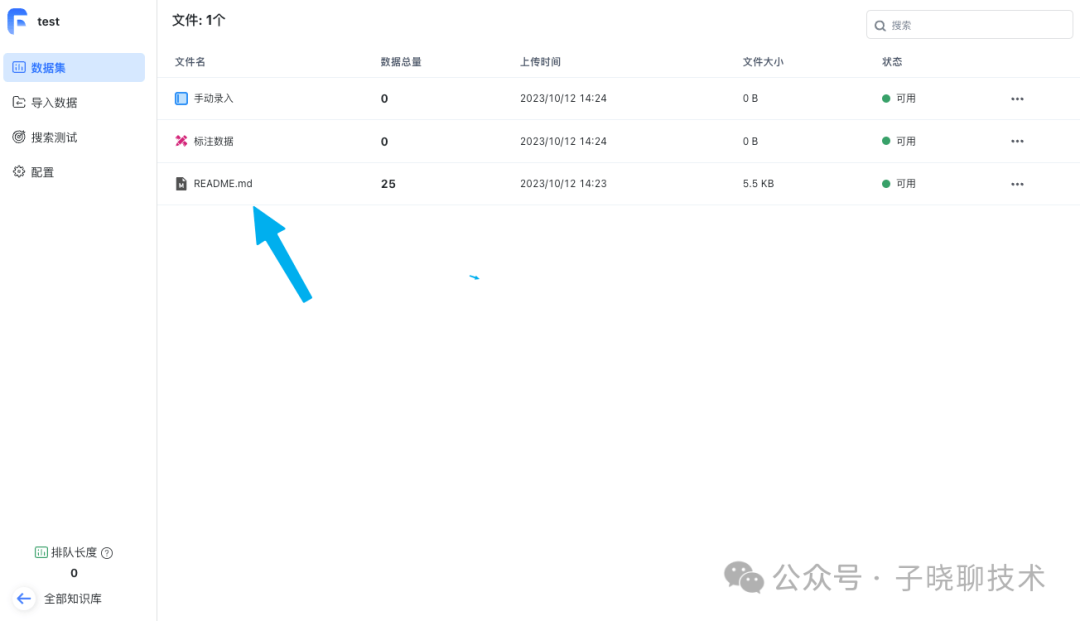

知识库创建完之后我们需要上传一点内容。

上传内容这里有四种模式:

-

手动输入:手动输入问答对,是最精准的数据

-

QA 拆分:选择文本文件,让AI自动生成问答对

-

直接分段:选择文本文件,直接将其按分段进行处理

-

CSV 导入:批量导入问答对

这里,我们选择 QA 拆分,让 AI 自动生成问答,若问答质量不高,可以后期手动修改。

点击上传后我们需要等待数据处理完成,等到我们上传的文件状态为可用。

点击「应用」按钮来新建一个应用,这里有四个模板,我们选择「知识库 + 对话引导」。

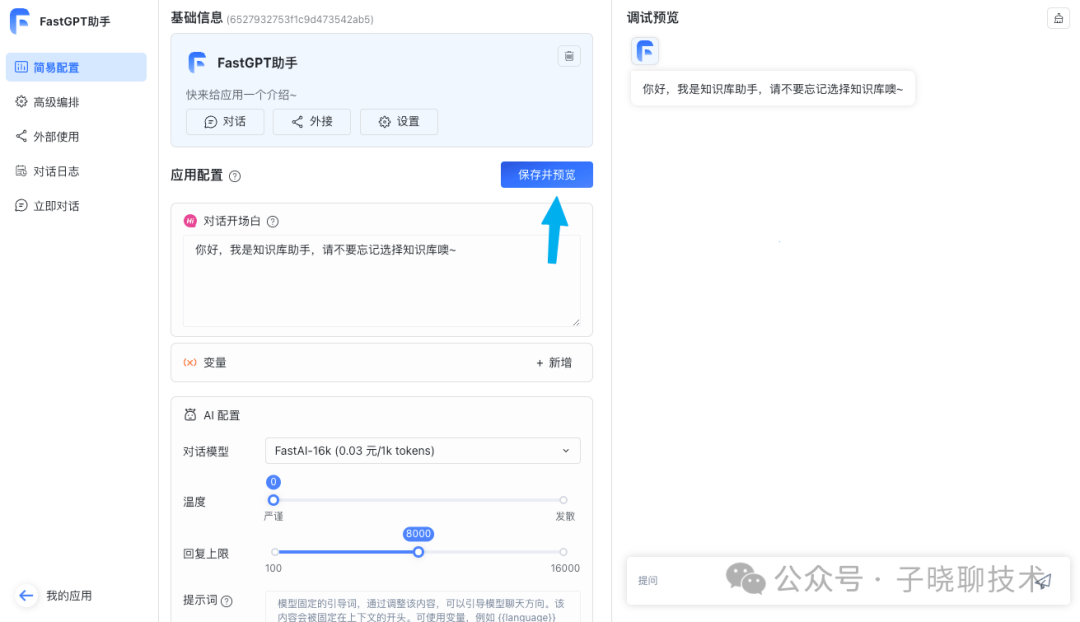

应用创建后来再应用详情页找到「知识库」模块,把我们刚刚创建的知识库添加进去。

添加完知识库后记得点击「保存并预览」,这样我们的应用就和知识库关联起来了。

然后我们就可以愉快的开始聊天啦。

fastGPT部署:

1、本地运行,如果想学习,就一步步来吧

2、docker compose部署, 你自己部署linux服务器需要解决代理环境。openai接口你懂得,科学上网。

3、 Sealos云部署, 如果自己玩一玩建议用这个,比较方便。

也许你会说,fastGPT 也可以搞本地大模型, 但我觉得用作本地私密知识库有点重了。默认情况下,FastGPT 只配置了 GPT 的模型,如果你需要接入其他模型,需要进行一些额外配置。One API是一个 OpenAI 接口管理 & 分发系统,可以通过标准的 OpenAI API 格式访问所有的大模型,开箱即用。部署和使用 One API,实现 Azure、ChatGLM 和本地模型的接入。

相关文章:

【AI+本地知识库】个人整理的几种常见本地知识库技术方案

【人工智能】电脑本地从零开始搭建属于自己的大模型

【AI+应用】一步步搭建聊天机器人搭配多种国内外大模型以及api接口调用

【AI+云部署】盘点开源项目免费云部署的几种技术方案

原文链接:【AI+知识库问答】沉浸式体验了解 AI知识库问答fastGPT