🔗🔗🔗🔗🔗

[NVIDIA GTC 2025技术总结与未来趋势分析]

🔗🔗🔗🔗🔗🔗🔗

一、核心技术突破与架构升级

-

AI与加速计算

- Blackwell Ultra GPU:基于Blackwell架构的B300 GPU性能提升1.5倍,内存容量达288GB,特别针对大模型推理优化,支持万亿参数模型训练和实时推理。

- Vera Rubin GPU:下一代架构预计2026年发布,采用HBM4E内存和NVLink 6交换机,目标突破算力瓶颈,支持通用人工智能发展。

- 光子网络技术:通过Quantum-X800 InfiniBand和Spectrum-X Ethernet,实现机架级“超级GPU”互联,降低延迟并提升能效。

-

量子计算融合

- NVIDIA量子研究中心(NVAQC) :整合CUDA-Q和cuQuantum工具链,推动量子-经典混合计算,聚焦药物研发和金融模拟场景。

- 量子纠错算法:通过硬件兼容(如D-Wave、IonQ设备接口)与软件优化(纠错算法库),提升量子计算可靠性。

-

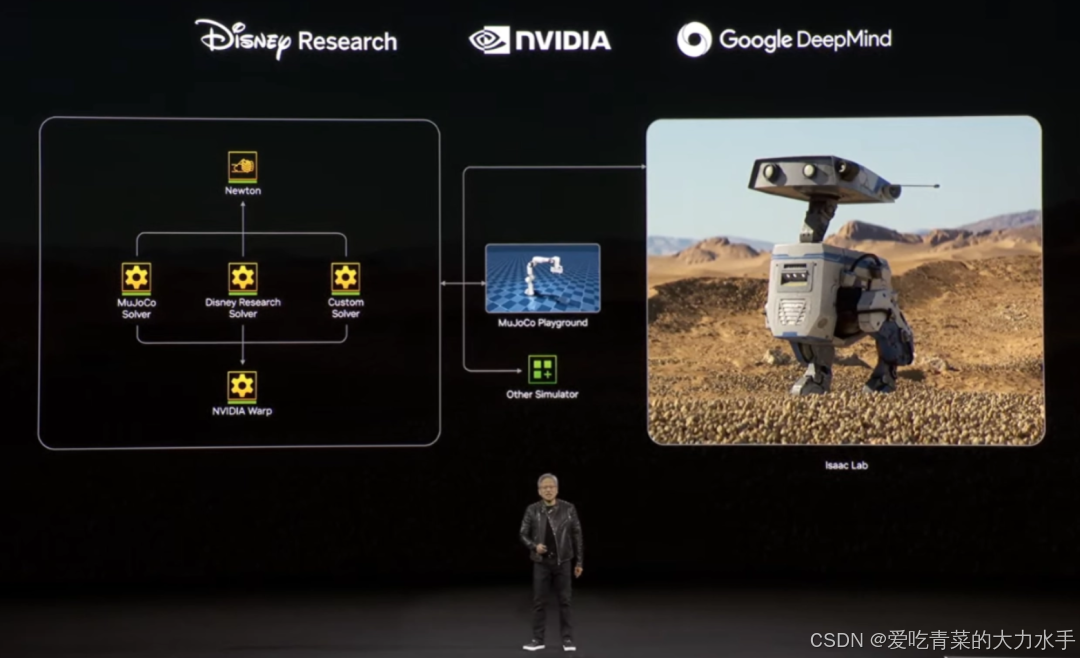

机器人技术生态

- Isaac GR00T N1开源模型:首个通用人形机器人基础模型,支持多模态输入和技能开发,预计2028年带动全球人形机器人市场达40亿美元。

- Newton物理引擎:与Google DeepMind合作开发,提供高精度机器人运动模拟,缩短真实环境部署周期。

二、未来技术趋势

-

AI计算范式转型

- 推理计算时代:随着大模型从训练转向部署,推理负载占比将超过80%。Blackwell Ultra的40TB机架内存和Dynamo开源推理平台(支持热中断和模型分片)成为核心解决方案。

- 边缘计算普及:华硕Ascent GX10等桌面级AI超算(1000 TOPS算力)推动边缘设备实时处理能力,应用于医疗影像、自动驾驶等领域。

-

AI与量子计算协同

- 混合计算架构:通过量子模拟加速经典AI训练(如分子动力学模拟),同时利用AI优化量子算法,形成技术闭环。

- 行业临界点:2025-2027年量子计算在化学合成、密码学等领域实现实用化突破,NVIDIA或主导中间层标准制定。

-

物理AI与工业数字化

- 数字孪生深化:Cosmos World模型支持工业场景的高保真仿真,结合AI代理实现工厂自动化决策,预估创造50万亿美元市场。

- 机器人即服务(RaaS) :通过GR00T Blueprint生成合成数据,降低机器人训练成本,加速物流、制造等场景落地。

三、对开发者的影响与工具链革新

-

开发工具升级

- CUDA-X AI增强:新增Python原生支持(如cuTile并行编程)、热中断检查点(CRIU)功能,降低分布式训练调试难度。

- TensorRT-LLM优化:通过Speculative Decoding技术提升推理吞吐量3倍,支持多块注意力机制和KV缓存重用。

-

端到端解决方案

- AI-Q框架:实现企业数据与AI代理的无缝连接,支持自然语言交互式数据分析。

- Dynamo平台:开源推理操作系统,集成模型压缩、服务编排和硬件感知调度,降低部署复杂度。

-

生态扩展挑战

- 硬件适配成本:Vera Rubin等新架构需开发者重构代码以利用HBM4E内存带宽,可能加剧硬件依赖性。

- 量子编程门槛:CUDA-Q虽简化量子算法开发,但混合编程模型(如QPU+GPU协同)仍需掌握量子力学基础。

四、行业应用案例

-

AI训练与推理

- 医疗领域:Blackwell Ultra加速癌症基因组分析,单次全基因组测序时间从72小时压缩至6小时。

- 自动驾驶:DriveOS LLM SDK支持多模态融合,提升复杂路况决策速度3倍。

-

边缘计算场景

- 工业质检:华硕RS501A-E12服务器搭载L40S GPU,实现产线实时缺陷检测(延迟<10ms)。

- 智慧城市:NVIDIA Metropolis平台优化交通流量预测,结合边缘设备降低云端数据传输成本90%。

五、总结与展望

NVIDIA GTC 2025标志着从单一硬件创新向全栈生态构建的转型:

- 技术层面:AI推理优化、量子-经典混合计算、物理AI将成为未来3-5年的核心赛道。

- 开发者应对:需关注CUDA-X的Python生态、开源模型(如GR00T N1)的二次开发,以及量子计算的基础能力储备。

- 产业影响:AI工厂、机器人即服务、边缘智能等模式将重塑制造业、医疗和城市管理,而NVIDIA通过硬件-软件-生态三位一体布局,持续巩固其技术霸权。